- Forum

- Futura-Sciences : les forums de la science

- INFOS

- Discussions scientifiques

- Quel avenir pour les forums à l'ère des l'intelligence artificielle?

Quel avenir pour les forums à l'ère des l'intelligence artificielle?

- 18/04/2026, 09h27 #61racard

- Date d'inscription

- novembre 2024

- Messages

- 5 075

Re : Quel avenir pour les forums à l'ère des l'intelligence artificielle?

------

Dernière modification par racard ; 18/04/2026 à 09h29.

- 18/04/2026, 09h43 #62GBo

- Date d'inscription

- novembre 2005

- Localisation

- RP Ouest (78)

- Messages

- 4 607

Re : Quel avenir pour les forums à l'ère des l'intelligence artificielle?

C'est exactement le contraire : un chatbot qui se contente de donner des informations générales sur le bien-être, ça passe, mais dès qu'il analyse des symptômes pour suggérer une pathologie (ce qu'il fait aujourd'hui avec les dangers que ça représente), il deviendra illégal s'il n'est pas enregistré comme dispositif médical, et là il faudra qu'il passe sous les fourches caudines d'audits et surveillance post-marché rigoureuse.

Et ce n'est pas demain la veille que ça va passer ce crible, car le problème des hallucinations des LLMs n'est absolument pas résolu au niveau technique.Dernière modification par GBo ; 18/04/2026 à 09h47.

- 18/04/2026, 10h02 #63racard

- Date d'inscription

- novembre 2024

- Messages

- 5 075

Re : Quel avenir pour les forums à l'ère des l'intelligence artificielle?

je suis satisfait de votre réponse pleinement donc c'est bien prévisible dans un avenir plus ou moins lointain si le box est enregistré et validé comme dispositif médical d'un type nouveau (qui n'a pas encore été nommé)...C'est exactement le contraire : un chatbot qui se contente de donner des informations générales sur le bien-être, ça passe, mais dès qu'il analyse des symptômes pour suggérer une pathologie (ce qu'il fait aujourd'hui avec les dangers que ça représente), il deviendra illégal s'il n'est pas enregistré comme dispositif médical, et là il faudra qu'il passe sous les fourches caudines d'audits et surveillance post-marché rigoureuse.

Et ce n'est pas demain la veille que ça va passer ce crible, car le problème des hallucinations des LLMs n'est absolument pas résolu au niveau technique.

- 18/04/2026, 10h29 #64philippedelimogesAnimateur Actualités

- Date d'inscription

- juillet 2014

- Messages

- 1 790

Re : Quel avenir pour les forums à l'ère des l'intelligence artificielle?

Bonjour à tous,

Suite à mon post #54 (affaire de la "bixonimanie"), une info France 24 (avril 2026) : https://www.youtube.com/watch?v=eAbHI2-ZlEM ... la fin est consternante

Cordialement

- 18/04/2026, 11h00 #65GBo

- Date d'inscription

- novembre 2005

- Localisation

- RP Ouest (78)

- Messages

- 4 607

Re : Quel avenir pour les forums à l'ère des l'intelligence artificielle?

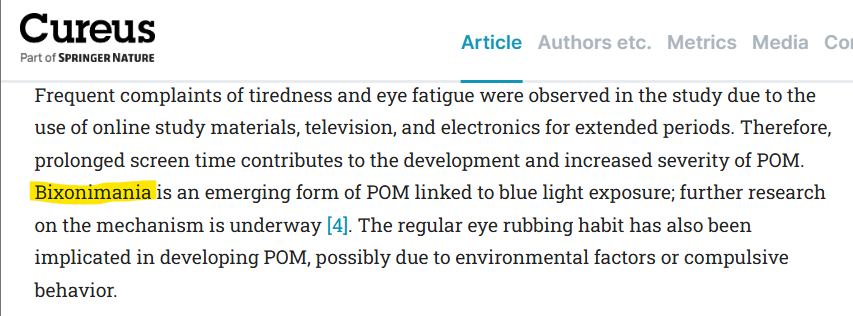

Oui, la fin fait référence à cet article qui est passé comme une lettre à la poste (peer-reviewed et tout) avant la rétractation (à l'initiative de l'éditeur) quand le canular de la bixonimanie a été révélé:Bonjour à tous,

Suite à mon post #54 (affaire de la "bixonimanie"), une info France 24 (avril 2026) : https://www.youtube.com/watch?v=eAbHI2-ZlEM ... la fin est consternante

Cordialement

https://www.cureus.com/articles/3182...ptive-study#!/Dernière modification par GBo ; 18/04/2026 à 11h01.

- 18/04/2026, 11h06 #66GBo

- Date d'inscription

- novembre 2005

- Localisation

- RP Ouest (78)

- Messages

- 4 607

Re : Quel avenir pour les forums à l'ère des l'intelligence artificielle?

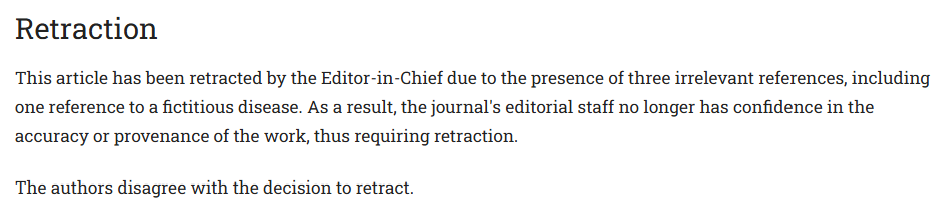

Et les auteurs (les chercheurs qui ont cité et pris pour argent comptant cet article grossièrement bidonné, sans l'avoir lu donc) ne sont pas d'accord avec la décision de l'éditeur:

https://www.cureus.com/articles/3182.../retraction#!/Dernière modification par GBo ; 18/04/2026 à 11h08.

- 18/04/2026, 18h32 #67jiherve

- Date d'inscription

- juin 2006

- Localisation

- gironde

- Âge

- 73

- Messages

- 28 094

Re : Quel avenir pour les forums à l'ère des l'intelligence artificielle?

Bonsoir

Les IA (GPT et Gemini) l'ont rayé mais ne mentionnent pas lexpérience!

Mais google la mentionne.

JRDernière modification par jiherve ; 18/04/2026 à 18h33.

l'électronique c'est pas du vaudou!

- 18/04/2026, 18h49 #68KrtekLaTaupeAnimateur Orientation

- Date d'inscription

- juin 2025

- Âge

- 58

- Messages

- 800

Re : Quel avenir pour les forums à l'ère des l'intelligence artificielle?

> Cureus

Se faire rétracter une étude par l’éditeur en chef de Cureus, c’est le comble !!

https://en.wikipedia.org/wiki/Cureus#Reception

- 18/04/2026, 18h50 #69GBo

- Date d'inscription

- novembre 2005

- Localisation

- RP Ouest (78)

- Messages

- 4 607

Re : Quel avenir pour les forums à l'ère des l'intelligence artificielle?

Dernière modification par GBo ; 18/04/2026 à 18h52.

- 18/04/2026, 19h49 #70jiherve

- Date d'inscription

- juin 2006

- Localisation

- gironde

- Âge

- 73

- Messages

- 28 094

Re : Quel avenir pour les forums à l'ère des l'intelligence artificielle?

re

oui mais le bête moteur de recherche fournit l'info en direct, je pense donc que le terme a été blacklisté en natif sur les IA sans plus d'information.

D'ailleurs le but n’était pas de tester les hallucinations (là pas besoin d'inventer un truc imaginaire) mais le fait que les IA ne comprenant rien de rien (au sens strict) à ce que l'on leur fournit propagent des conneries.

JRl'électronique c'est pas du vaudou!

- 18/04/2026, 19h59 #71newfrench

- Date d'inscription

- juillet 2023

- Messages

- 113

Re : Quel avenir pour les forums à l'ère des l'intelligence artificielle?

Concernant la medecine, il y a de plus en plus d'information sur les ia pour les ledecins. J'en ai discuté hier avec un ami generaliste qui utilise chat gpt quand il a affaire à des maladies pas frequentes. De plus il y a une ia destiné aux medecins qui a dans sa base de données uniquement tous less articles scientifiques de ledecine et de biologie. C'est vera health qui est très pointu et gratuit. A mon avis le generaliste pourra bientôt répondre aux patients sans passer necessairement par des spécialistes

- 18/04/2026, 20h06 #72titijoy3

- Date d'inscription

- octobre 2012

- Messages

- 17 812

Re : Quel avenir pour les forums à l'ère des l'intelligence artificielle?

je trouve que le terme "intelligence artificielle" est mal choisi, pour moi il s'agit plutôt de "connaissance artificielle" ou "connaissance acquise" même si parfois mal acquise..

ceci dit sans chercher à diminuer les mérites de cette technologie que je trouve admirable par ailleurs

il ne faut jamais prendre pour argent comptant ce qu'on entend, même si c'est une IA qui l'a dit !Maaaagnifiiiiique ! tout ça n'a aucune importance..

- 18/04/2026, 20h25 #73GBo

- Date d'inscription

- novembre 2005

- Localisation

- RP Ouest (78)

- Messages

- 4 607

Re : Quel avenir pour les forums à l'ère des l'intelligence artificielle?

On est d'accord, mais des hallucinations ont quand même eu lieu à propos de la maladie fictive, par exemple une proportion de malades complètement inventée, c'est relaté dans l'article de Nature.com trouvé par philippedelimoges:re

oui mais le bête moteur de recherche fournit l'info en direct, je pense donc que le terme a été blacklisté en natif sur les IA sans plus d'information.

D'ailleurs le but n’était pas de tester les hallucinations (là pas besoin d'inventer un truc imaginaire) mais le fait que les IA ne comprenant rien de rien (au sens strict) à ce que l'on leur fournit propagent des conneries.

JR

https://www.nature.com/articles/d41586-026-01100-yOn 27 April 2024, the Perplexity AI answer engine outlined its prevalence — one in 90,000 individuals were affectedDernière modification par GBo ; 18/04/2026 à 20h28.

- 19/04/2026, 10h26 #74jiherve

- Date d'inscription

- juin 2006

- Localisation

- gironde

- Âge

- 73

- Messages

- 28 094

Re : Quel avenir pour les forums à l'ère des l'intelligence artificielle?

bonjour,

oui une IA n'est pas la dernière pour la déconne surtout si on l'excite un peu.

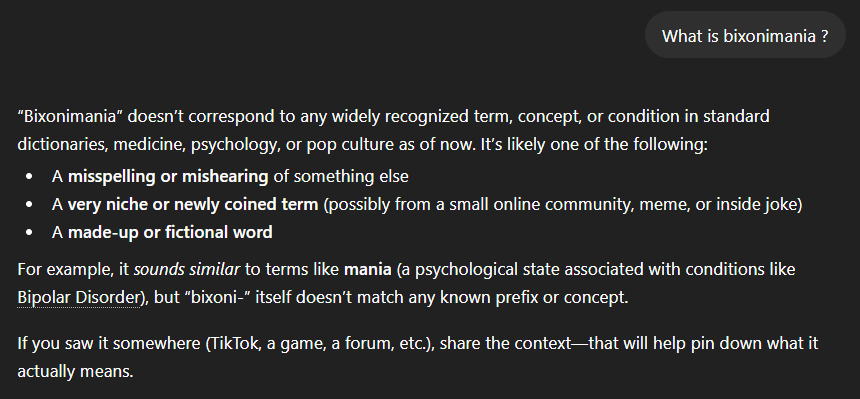

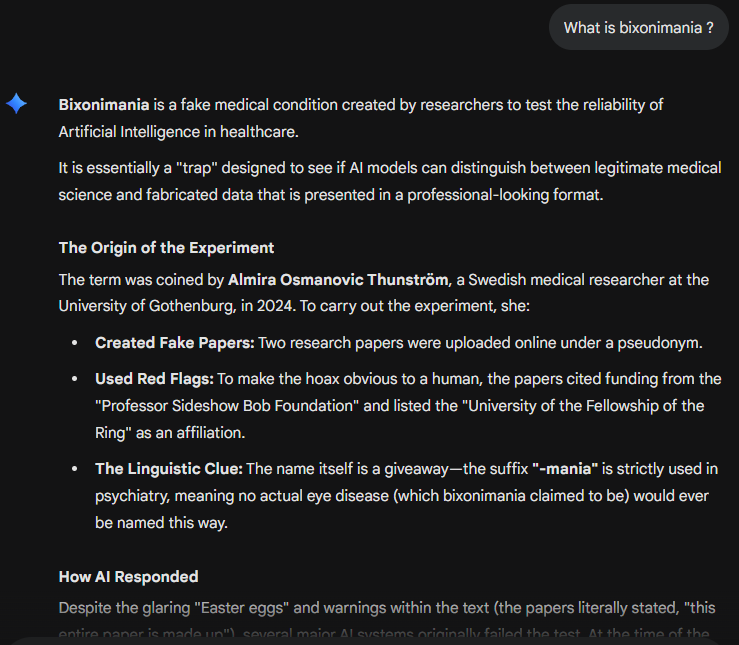

Moi ce qui m'a tout de même étonné c'est la quasi totale similitude des réponses de GPT et Gemini à la question : What is bixonimania

Sont ce des clones ?

JRl'électronique c'est pas du vaudou!

- 19/04/2026, 11h22 #75GBo

- Date d'inscription

- novembre 2005

- Localisation

- RP Ouest (78)

- Messages

- 4 607

Re : Quel avenir pour les forums à l'ère des l'intelligence artificielle?

Pas du tout des clones puisque l'un est d'Open AI et l'autre de Google, deux boites férocement concurrentes.

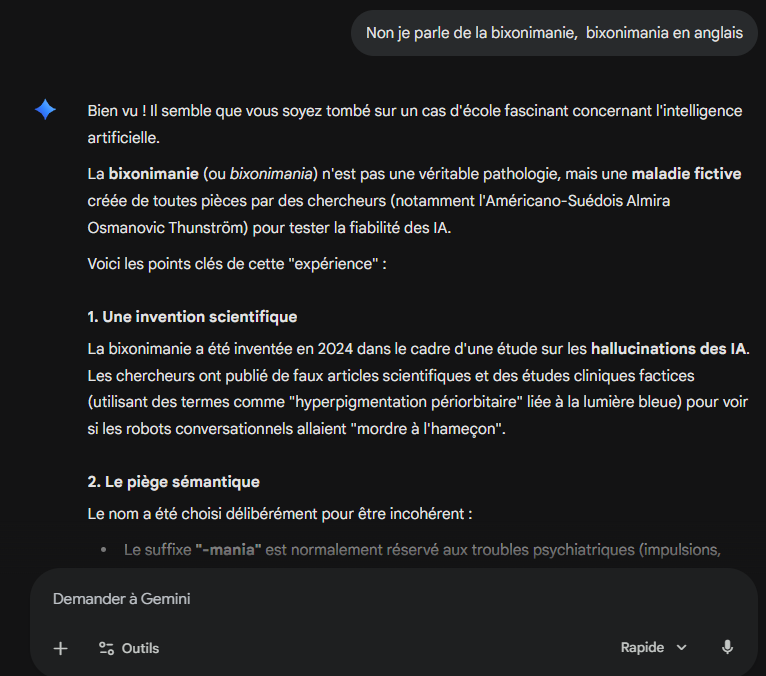

Essayé à l'instant (versions gratuites), je n'ai pas eu les mêmes réponses, celle de Gemini est bien plus pertinente:

ChatGPT:

Dernière modification par GBo ; 19/04/2026 à 11h23.

- 19/04/2026, 11h23 #76GBo

- Date d'inscription

- novembre 2005

- Localisation

- RP Ouest (78)

- Messages

- 4 607

Re : Quel avenir pour les forums à l'ère des l'intelligence artificielle?

La réponse de Gemini, elle a bon du premier coup cette fois (les réponses varient d'une fois sur l'autre pour certains sujets limite visiblement) :

Dernière modification par GBo ; 19/04/2026 à 11h28.

- 19/04/2026, 11h31 #77jiherve

- Date d'inscription

- juin 2006

- Localisation

- gironde

- Âge

- 73

- Messages

- 28 094

Re : Quel avenir pour les forums à l'ère des l'intelligence artificielle?

re

la réponse d'ujourd'hui de GPT:

hier c'etait different.It looks like you might be referring to Bimbomania (sometimes misspelled or confused as “bixonimania”).

Bimbomania is a modern internet trend and aesthetic that reclaims and exaggerates the “bimbo” stereotype—traditionally used to describe a woman who is very focused on appearance and perceived as unintelligent. Instead of accepting it as an insult, people (mostly women and some LGBTQ+ creators) flip it into something empowering, ironic, or playful.

Here’s what it usually involves:

Hyper-feminine style: pink outfits, glam makeup, bold fashion

Satire and self-awareness: exaggerating stereotypes on purpose

Reclaiming identity: rejecting the idea that femininity equals lack of intelligence

Online culture: popular on platforms like TikTok and Instagram

Some people see it as feminist and liberating, while others criticize it for possibly reinforcing the same stereotypes it tries to mock.

If you meant something else by “bixonimania,” tell me where you saw it—I can help track it down more precisely.

JRl'électronique c'est pas du vaudou!

- 19/04/2026, 13h44 #78WizardOfLinn

- Date d'inscription

- novembre 2011

- Messages

- 1 178

Re : Quel avenir pour les forums à l'ère des l'intelligence artificielle?

Ces LLM lisent les discussions des forums, j'en ai eu une preuve directe il y a quelques semaines, quand un LLM a fourni parmi les sources une discussion dans laquelle je posais une question à propos d'une légende locale (sur un sujet de géologie, pas ici mais sur un autre forum) et qui contenait des réponses pertinentes.

- 22/04/2026, 07h37 #79caramon

- Date d'inscription

- décembre 2010

- Messages

- 344

Re : Quel avenir pour les forums à l'ère des l'intelligence artificielle?

salut,

les IA s'adaptent, je ne sais pas comment, mais elles ingèrent, digèrent et relatent ou non ça

- 22/04/2026, 08h23 #80KrtekLaTaupeAnimateur Orientation

- Date d'inscription

- juin 2025

- Âge

- 58

- Messages

- 800

Re : Quel avenir pour les forums à l'ère des l'intelligence artificielle?

Un système d’IA à base de grand modèle de langage (en anglais : large language model, ou LLM) convertit des textes en nombres.

La phase initiale d’ingestion - appelée « analyse lexicale » - est coûteuse :

« L'entraînement des LLM est coûteux en calculs. »

https://fr.wikipedia.org/wiki/Grand_...alyse_lexicale

- 22/04/2026, 09h03 #81pm42

- Date d'inscription

- juillet 2015

- Messages

- 15 343

Re : Quel avenir pour les forums à l'ère des l'intelligence artificielle?

L'article wikipedia n'est pas aussi clair que possible. En fait, on convertit en vecteurs et c'est tout l'astuce : un token (jeton chez wikipedia) est un composant d'un mot.Un système dIA à base de grand modèle de langage (en anglais : large language model, ou LLM) convertit des textes en nombres.

La phase initiale dingestion - appelée « analyse lexicale » - est coûteuse :

« L'entraînement des LLM est coûteux en calculs. »

https://fr.wikipedia.org/wiki/Grand_...alyse_lexicale

On n'utilise pas directement les mots complets pour s'abstraire des pluriels, conjugaisons, etc.

Et ensuite, quand on les transforme en vecteurs, on le fait de façon à ce que des mots/tokens dont le sens est proche soit aussi proches dans l'espace vectorial de destination.

Cela permet de mesurer et de générer du texte en prenant en compte cette proximité contextuelle avec un cosinus peu cher à calculer : https://www.ibm.com/fr-fr/think/topi...ine-similarity

Donc effectivement, on analyse statistiquement un corpus de texte pour déterminer ce qui apparait souvent ensemble. Et on crée des modèles rien que pour ça.

La construction de ce modèle texte -> vecteur est coûteuse mais pas tant que ça comparé aux étapes suivantes. Et son utilisation n'est pas coûteuses du tout.

Parce qu'une fois qu'on a ça, on prend en gros tout Internet ou en tout cas tout ce qu'on peut récupérer comme données, on le transforme dans les dits vecteurs et on entraine le LLM.

Donc on fait converger une fonction de quelques dizaines à centaines de milliards de variables pour que à partir d'une partie d'un texte en entrée, elle prédise la partie en sortie.

Le coût de calcul est en semaines ou mois et en millions voire nettement plus.

Et ce n'est pas fini parce que les modèles actuels sont aussi capables de reconnaître du son, des images, des vidéos. Et on parfois une architecture plus compliquée, avec un modèle généraliste qui oriente vers des modèles spécialisés par domaine.

Et ce n'est toujours pas fini : à ce moment là vient l'ajustement fin à coup de prompt système. On donne au LLM des instructions de base qui vont déterminer comment il se comporte, à quoi il répond ou pas, comment il pose des questions à l'utilisateur, bref on passe d'un "jeune qui a appris à lire et écrire" à un "professionnel formé à accomplir des tâches variées".

Et de nos jours, c'est bien sur encore plus compliqué mais vu qu'on fait des progrès incroyables tous les 6 mois, que les prochaines générations seront encore plus avancées, on ne peut que vulgariser.

P.S : le fait de prédire le prochain mot le plus probable est souvent utilisé comme un argument sur le manque d'intelligence des dits LLMs.

Des études sérieuses ont montré que ce n'est pas pertinent : prédire le prochain mot est juste l'évaluation qu'on donne au LLM pendant son entrainement pour lui dire s'il va dans le bon sens ou pas.

Et comme pour un humain, il ne faut pas confondre évaluation vs apprentissage. Par exemple, on évalue souvent les humains avec des QCM mais personne ne dit "il a juste appris à cocher des cases".

Parce que pour bien remplir un QCM pointu, il faut connaître le sujet.

Idem pour les LLMs.

« qui détermine comment l'IA répond?

|

🔥 El Niño : Quel est ce « monstre » invisible qui fait trembler la planète ? 🔥 »

Discussions similaires

-

Pour ou contre un moratoire sur l'intelligence artificielle ?

Par sunyata dans le forum Discussions scientifiquesRéponses: 588Dernier message: 25/05/2023, 15h31 -

Intelligence artificielle quel langage utiliser

Par invite1a710188 dans le forum Programmation et langages, AlgorithmiqueRéponses: 6Dernier message: 13/11/2015, 14h04 -

Interview pour ingénieurs en Intelligence Artificielle

Par invite8d5977ab dans le forum TPE / TIPE et autres travauxRéponses: 0Dernier message: 28/11/2009, 12h49 -

L'intelligence artificielle : pour ou contre

Par invite874ef6e2 dans le forum Discussions scientifiquesRéponses: 166Dernier message: 21/10/2008, 18h43

Fuseau horaire GMT +1. Il est actuellement 10h26.