Je ne peux pas aider, jai juste utilisé Safari sur ipad

Autant que je sache, et en gros, les signaux neuronaux biologiques sont aussi binaires (spikes). Le modèle utilisé (sans impulsion) par les réseaux convolutionnels artificiels sont totalement faux biologiquement parlant (en fait ils marchent mieux dans les applications industrielles).

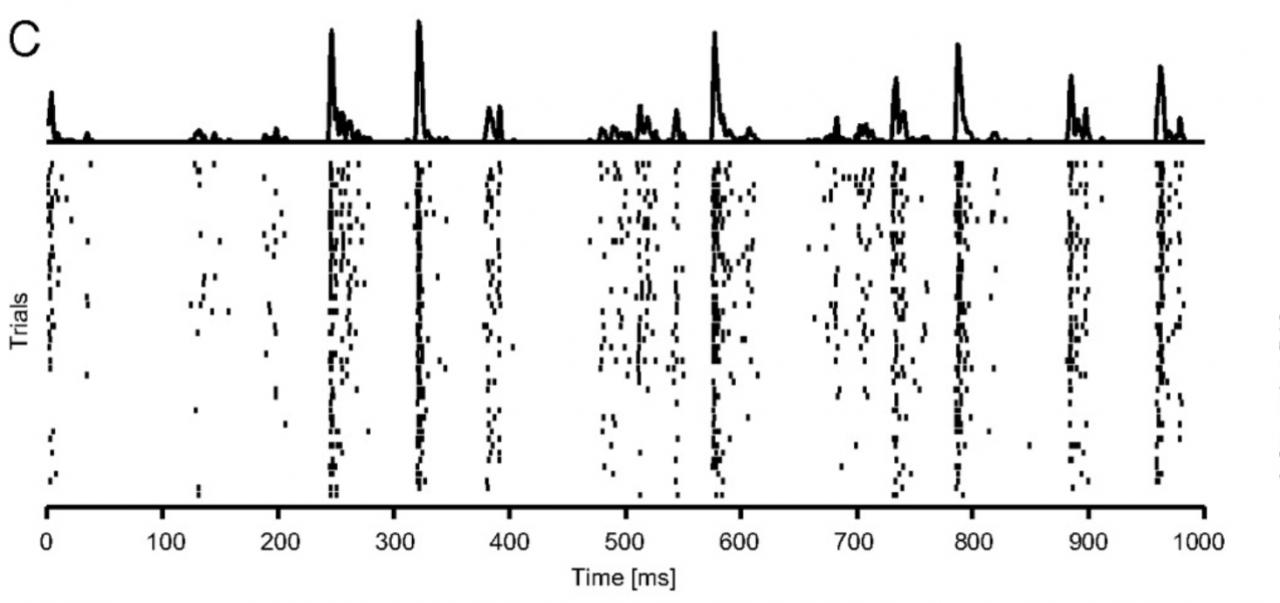

Nos signaux dinput sont donc aussi transformés en 0/1, pour illustrer voilà des timestamps de spikes pour un circuit auditif biologique: (attention je ny connais rien en circuits auditifs, hein )

Ici: https://www.pnas.org/doi/10.1073/pnas.1012656107

-----