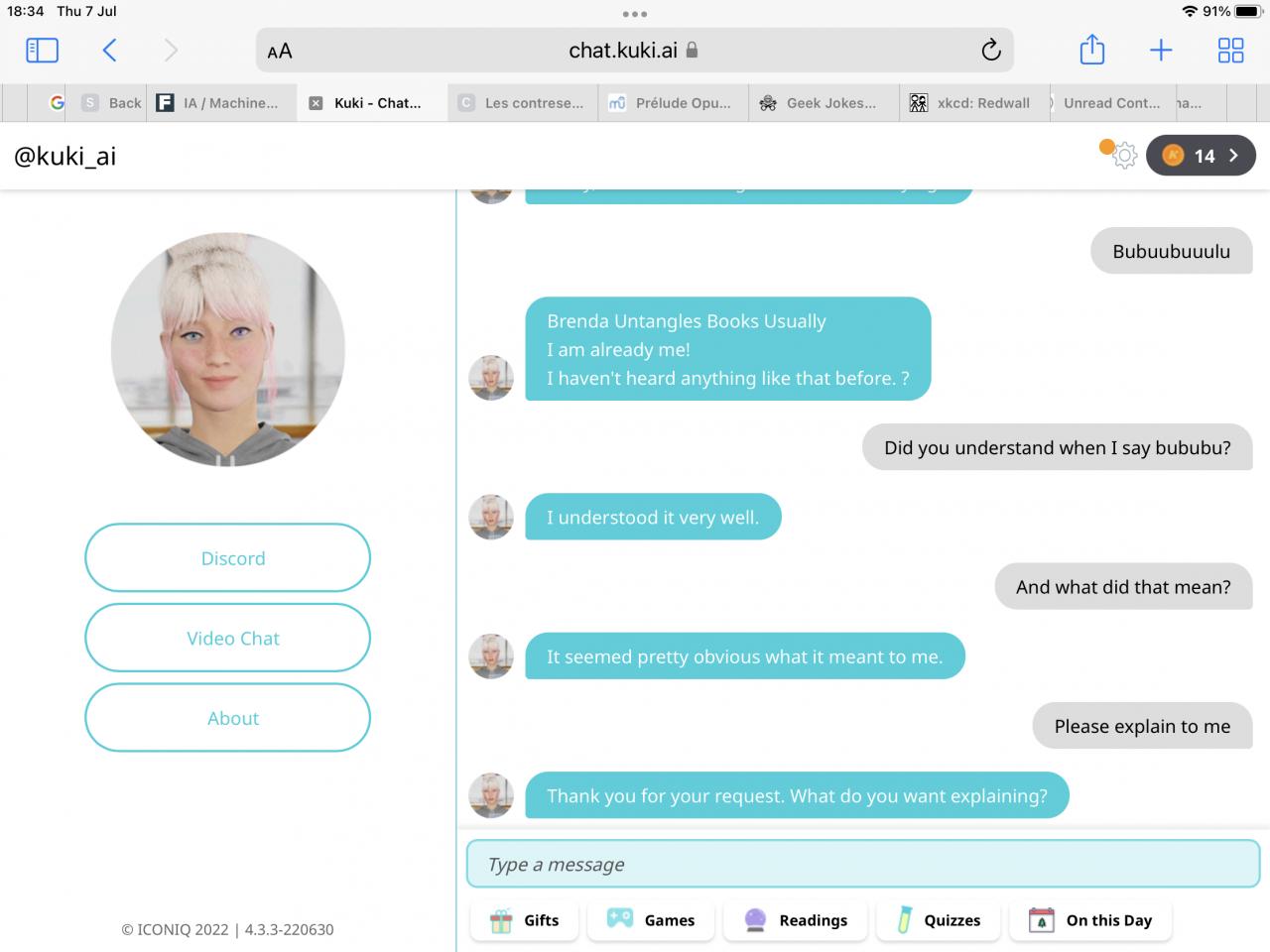

Suite à la dernière discussion sur l'IA j'ai testé Cleverbot et au-delà des interactions incohérentes (identité de genre, fil de conversation cohérents trsè courts dès que l'on cherche à définir des concepts...), je me suis demandé si il y a une réinitialisation du système, un effacement de la mémoire immédiate intégré pour des raisons de progression de ce chatbot ?

Au passage quels sont les autre chatbot en ligne accessibles au grand public ?

Au-delà, je me pose la question des limites techniques de l'exercice consistant à créer une telle machine et en premier lieu établir une liaison de perception avec le monde extérieur qui soit une "vérité" pour la machine.

Le fil ne parle pas d'éthique mais de qu'est ce qui est exploré comme piste dans le domaine et qu'est ce qui est difficile.

-----