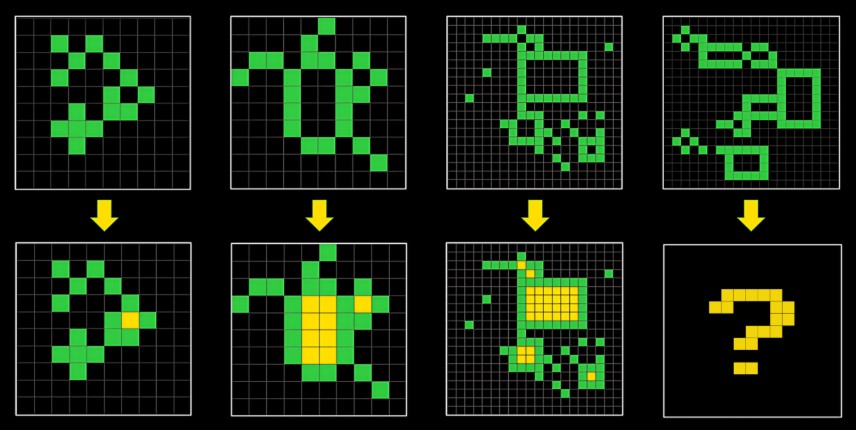

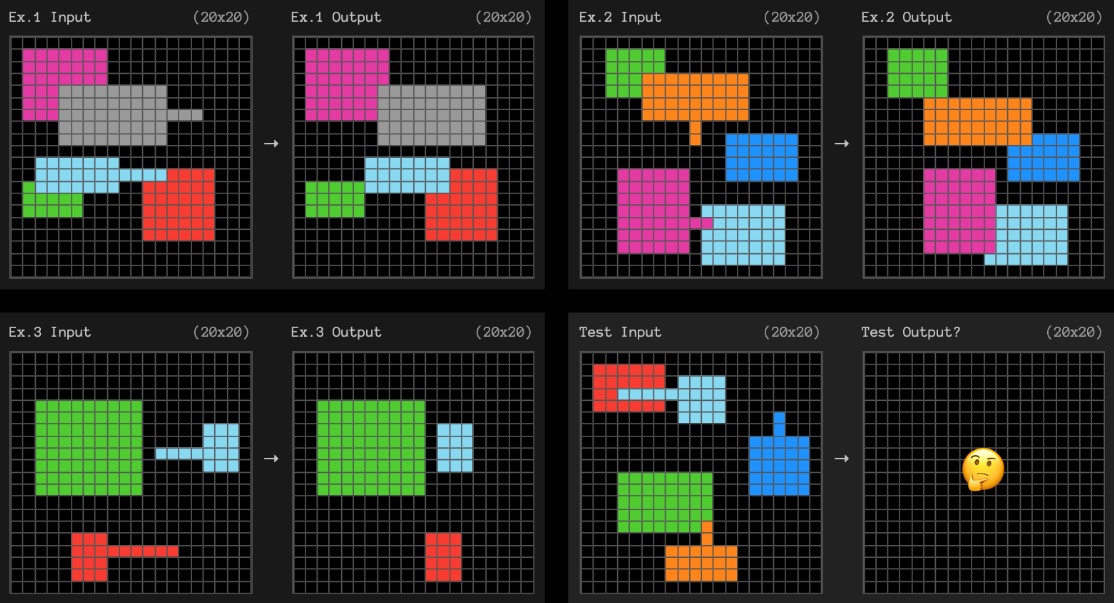

Le nouveau venu d'OpenAI appelé o3 fait bien mieux que o1 sur des tests ARC-AGI* qui ressemblent à des tests "psychométriques" de logique graphique assez faciles pour les humains mais (jusqu'ici) difficiles pour les IA.

Le papier est ici, signé de François Chollet (bien connu pour ses bouquins sur le Deep Learning):

"OpenAI o3 Breakthrough High Score on ARC-AGI-Pub"

https://arcprize.org/blog/oai-o3-pub-breakthrough

A vos commentaires.

(*) https://arxiv.org/abs/1911.01547

-----

pour une toute petite propriété émergente.... ( un raisonnement artificiel implicite, qui pourrait être une petite démarche de classification, suivie d'une induction fondée sur les rapports entre classes, puis de classification de la question suivante... et déduction si la classification a donné le résultat attendu....???

pour une toute petite propriété émergente.... ( un raisonnement artificiel implicite, qui pourrait être une petite démarche de classification, suivie d'une induction fondée sur les rapports entre classes, puis de classification de la question suivante... et déduction si la classification a donné le résultat attendu....???

Il ne manque pas de culot!

Il ne manque pas de culot!